Уральцев предупреждают о новых схемах мошенничества с ИИ

Бесплатные чат-боты могут представлять повышенную угрозу из-за слабой защиты данных.

В России распространяется новый вид кибермошенничества, где злоумышленники активно применяют искусственный интеллект, дополняя или заменяя им методы социальной инженерии.

При использовании ИИ-сервисов важно обращать внимание на условия пользовательского соглашения.

Детали механизмов таких атак раскрыл Владислав Тушканов, руководитель группы исследований технологий машинного обучения «Лаборатории Касперского».

По его словам, ИИ используется преступниками на различных этапах — от первого контакта с потенциальной жертвой до разработки вредоносного кода.

«Мы регулярно фиксируем использование ИИ для создания фишинговых страниц, написания программ-вымогателей (например, FunkSec), а также инструментов для продвинутых целевых атак, подобных операциям группы Bluenoroff», — отметил Тушканов.

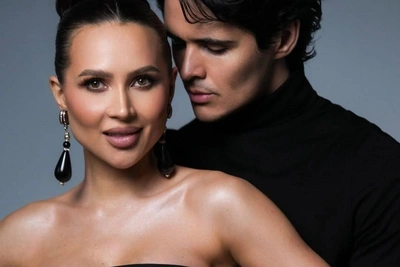

Одной из распространённых техник стал дипфейк — поддельные видео- или аудиосообщения, созданные с помощью ИИ. Мошенники используют их для кражи конфиденциальных данных и финансовых средств пользователей.

Рост популярности ИИ-сервисов среди обычных людей несёт дополнительные риски. Даже на официальных платформах возможны утечки данных из-за кибератак или ошибок в конфигурации.

«Причинами могут быть как кибератаки, так и ошибки в архитектуре или конфигурации сервисов, — продолжил эксперт. — Крупные ИТ-компании следят за безопасностью, но пользователи нередко обращаются к малоизвестным сервисам или бесплатным версиям чат-ботов, уровень защиты которых может быть ниже».

«Проблема в том, что такие сервисы часто не раскрывают информацию о политике конфиденциальности. Если их создатели окажутся недобросовестными, данные пользователя могут быть скомпрометированы», — добавил Владислав Тушканов.

Важно помнить, что любая информация, введённая в чат-бот, теоретически может использоваться провайдером сервиса — например, для обучения и улучшения моделей искусственного интеллекта.

«Мы сталкивались с примером, когда сайт предлагал доступ к ChatGPT, и пользователь получал возможность работать с ботом. Однако параллельно на этом же ресурсе публиковались переписки пользователей в открытом доступе, — обратил внимание эксперт. — Поэтому при работе с ИИ-сервисами важно задавать себе вопрос: является ли информация, которую я загружаю, конфиденциальной и критичной для меня или моей компании?»

Не следует передавать чат-ботам конфиденциальные корпоративные или личные данные, так как из-за потенциальных утечек они могут стать публичными.

Специалист рекомендует придерживаться нескольких базовых правил безопасности:

- Включать двухфакторную аутентификацию везде, где это возможно.

- Не переходить по подозрительным ссылкам в сообщениях.

- Применять уникальные сложные пароли и использовать менеджеры паролей.

- При получении аудио- или видеосообщений, особенно касающихся финансовых действий, проверять, действительно ли человек на записи является тем, за кого себя выдаёт.

В качестве примеров дипфейков можно упомянуть фальшивые кадры с мэром Екатеринбурга Алексеем Орловым и губернатором Свердловской области Денисом Паслером.